Les API constituent le tissu conjonctif de toute application moderne. REST domine toujours le paysage en 2026, mais GraphQL, gRPC et tRPC gagnent du terrain sur des cas d'usage précis. Ce guide compare les architectures API actuelles, leurs forces et leurs limites, et explore les tendances qui redéfinissent la manière dont les systèmes communiquent entre eux.

Sommaire

Les interfaces de programmation applicative, plus connues sous le nom d'API, sont au coeur de la transformation numérique. Chaque application que vous utilisez au quotidien, qu'il s'agisse d'une application mobile de livraison, d'un tableau de bord analytique ou d'un outil de collaboration, repose sur des dizaines, voire des centaines d'API qui orchestrent les échanges de données entre services. En 2026, le volume de trafic API représente plus de 80 % des échanges sur le web, selon les données de Cloudflare.

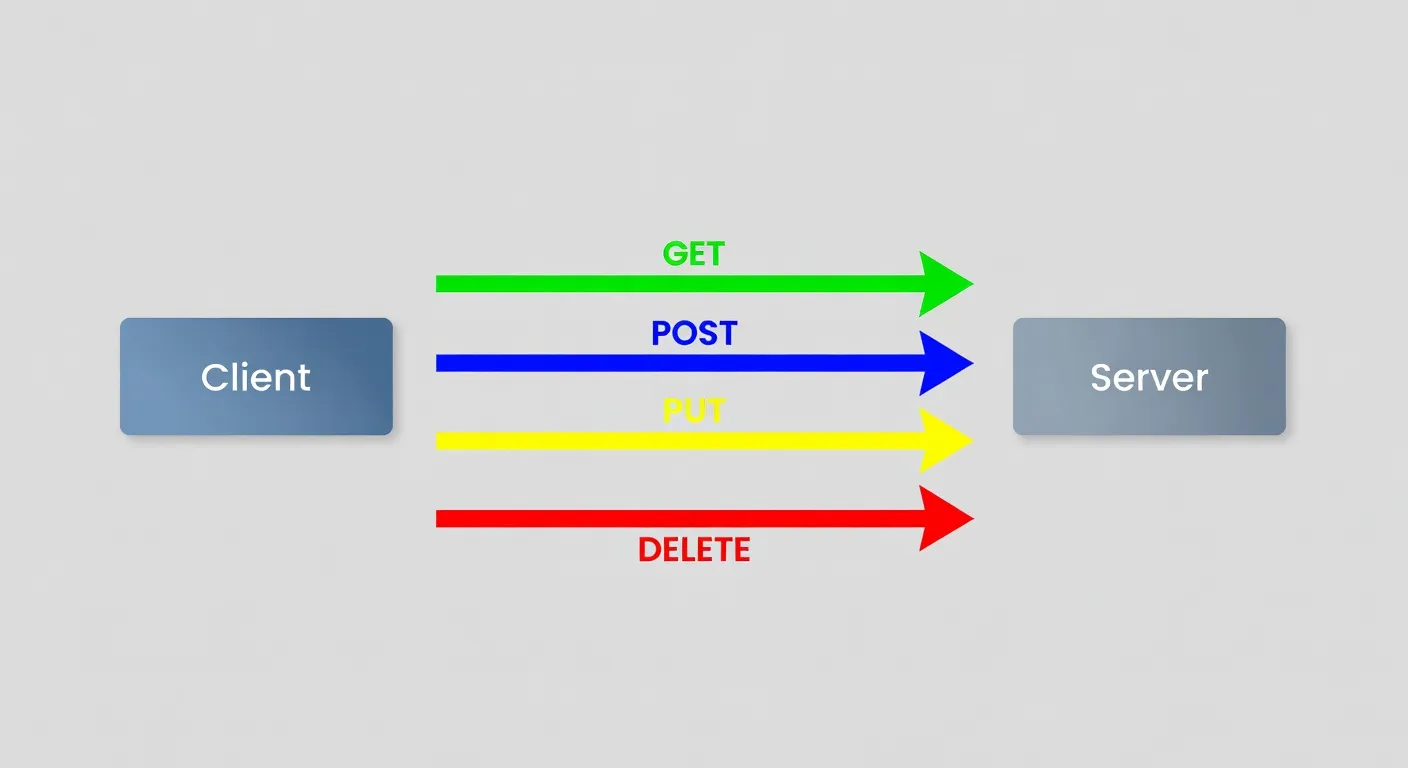

Pendant près de deux décennies, REST a régné sans partage sur l'architecture des API web. Son modèle basé sur les ressources et les méthodes HTTP s'est imposé comme la lingua franca du développement logiciel. Mais le paysage se diversifie. GraphQL, porté par Meta, a séduit les équipes confrontées à des interfaces riches et des besoins de données hétérogènes. gRPC s'est imposé dans les architectures microservices à forte volumétrie. tRPC a conquis l'écosystème TypeScript avec sa promesse de typage de bout en bout sans génération de code.

Ce guide propose un comparatif honnête de ces architectures, sans dogmatisme. Chaque approche a ses forces et ses contextes de pertinence. L'objectif est de vous donner les clés pour faire un choix éclairé en fonction de votre projet, de votre équipe et de vos contraintes techniques. Pour aller plus loin dans la pratique, vous trouverez des tutoriels pratiques sur les API REST qui complètent cette vue d'ensemble.

REST en 2026 : un standard qui évolue

REST (Representational State Transfer) reste l'architecture API la plus utilisée au monde en 2026. Les rapports de Postman et de RapidAPI confirment que plus de 85 % des API publiques suivent les conventions REST. Cette domination s'explique par des qualités fondamentales qui n'ont pas perdu leur pertinence : simplicité conceptuelle, compatibilité universelle avec HTTP, statelessness qui facilite la mise à l'échelle et un outillage mature.

Les principes REST revisités

Les six contraintes architecturales définies par Roy Fielding dans sa thèse de 2000 restent le socle théorique de REST. Mais la pratique a considérablement évolué. Les API REST modernes intègrent des mécanismes qui n'existaient pas dans la spécification originale : pagination standardisée, filtrage avancé, versioning par en-tête ou par URL, et support natif des webhooks pour les communications asynchrones.

La spécification OpenAPI (anciennement Swagger) a joué un rôle déterminant dans la professionnalisation des API REST. En version 3.1, elle est entièrement compatible avec JSON Schema, ce qui permet de décrire des structures de données complexes avec précision. Un fichier OpenAPI bien rédigé sert à la fois de documentation, de contrat d'interface, de base pour la génération de SDK clients et de référence pour les tests automatisés.

REST : forces et faiblesses en 2026

| Critère | Force | Faiblesse |

|---|---|---|

| Simplicité | Facile à comprendre et à implémenter | Over-fetching et under-fetching fréquents |

| Cache | Cache HTTP natif, CDN compatibles | Invalidation complexe sur les données dynamiques |

| Outillage | Postman, Insomnia, OpenAPI, Swagger UI | Pas de typage natif côté client |

| Performance | Léger, pas de surcharge de parsing | Multiples requêtes pour les données imbriquées |

| Adoption | Standard universel, tous les langages supportés | Conventions variables d'une API à l'autre |

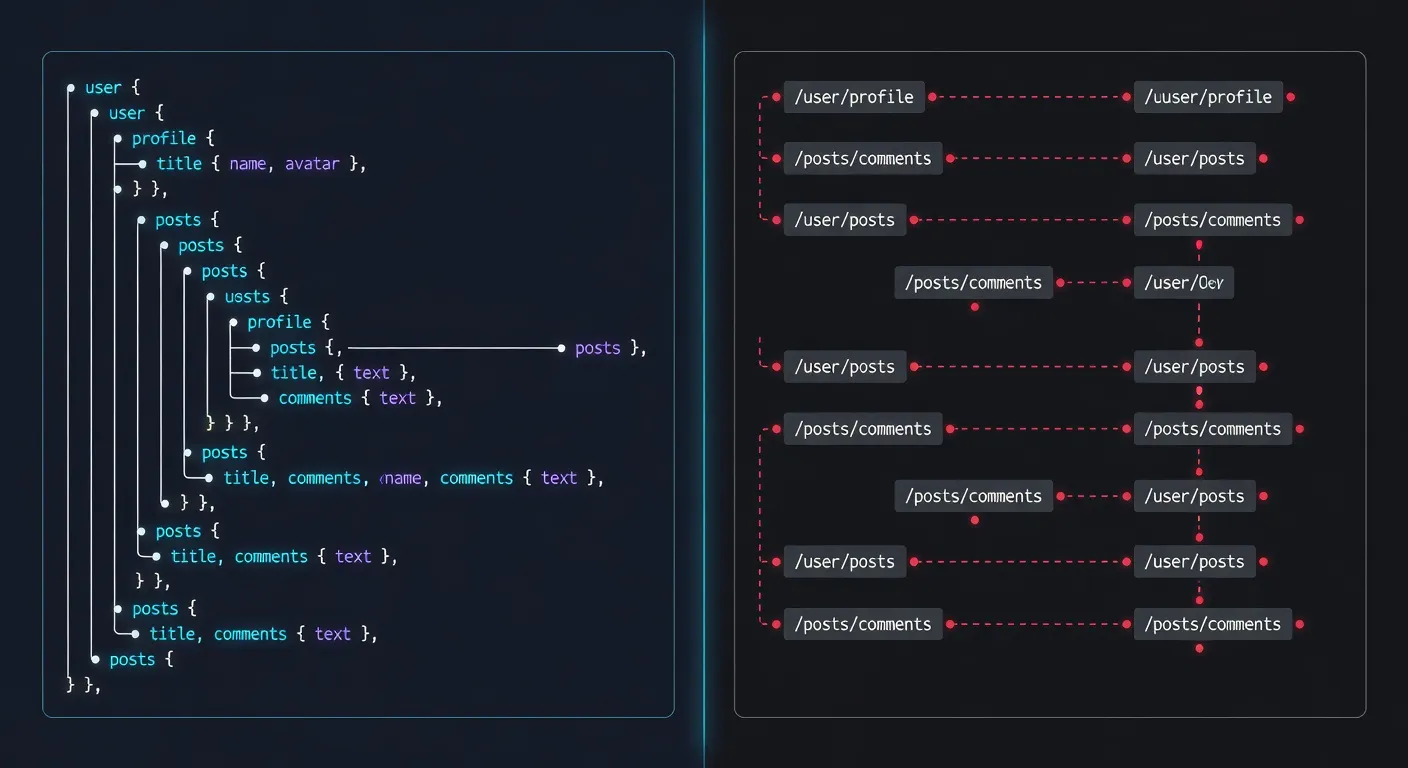

Le problème le plus souvent cité contre REST est le sur-fetching : le serveur retourne des objets complets alors que le client n'a besoin que de quelques champs. Sur une application mobile avec une connexion limitée, cette surcharge de données devient un problème de performance réel. Le sous-fetching, qui oblige le client à enchaîner plusieurs requêtes pour assembler les données d'un écran, est l'autre reproche récurrent. C'est précisément pour résoudre ces deux problèmes que GraphQL a été créé.

Malgré ces limites, REST conserve des avantages décisifs pour de nombreux cas d'usage. Le cache HTTP fonctionne nativement avec les CDN et les proxies inverses, ce qui est un atout majeur pour les API à fort trafic. La simplicité du modèle réduit la courbe d'apprentissage pour les nouveaux développeurs. Et l'universalité du protocole HTTP garantit la compatibilité avec tous les langages et toutes les plateformes. Pour un guide complet du développement web, REST reste souvent le point de départ recommandé.

GraphQL : avantages et limites en production

GraphQL a été développé en interne chez Facebook à partir de 2012 pour répondre aux besoins spécifiques de l'application mobile. Rendu open source en 2015, il s'est progressivement imposé comme une alternative crédible à REST pour les applications avec des interfaces riches et des modèles de données complexes. En 2026, GraphQL est utilisé en production par des entreprises comme GitHub, Shopify, Twitter, PayPal et Airbnb.

Le modèle de requête GraphQL

La force fondamentale de GraphQL réside dans son modèle de requête déclaratif. Le client décrit exactement la structure de données dont il a besoin, et le serveur retourne une réponse qui correspond exactement à cette structure. Plus de sur-fetching, plus de sous-fetching. Une seule requête peut traverser un graphe de relations complexes et retourner des données imbriquées provenant de multiples sources.

Le système de types de GraphQL constitue un autre avantage majeur. Chaque API GraphQL expose un schéma fortement typé qui décrit toutes les données disponibles, leurs relations et les opérations possibles. Ce schéma sert de contrat vivant entre le frontend et le backend. Les outils comme GraphiQL et Apollo Studio exploitent ce schéma pour fournir de l'autocomplétion, de la validation en temps réel et une documentation générée automatiquement.

Les limites que les tutoriels ne mentionnent pas

L'enthousiasme autour de GraphQL a parfois occulté ses difficultés réelles en production. Le problème N+1, où une requête GraphQL déclenche des dizaines de requêtes en base de données, est le piège le plus classique. Les solutions existent (DataLoader, batching, compilation de requêtes), mais elles ajoutent de la complexité côté serveur.

Le cache est un autre point délicat. REST bénéficie du cache HTTP natif grâce aux URL uniques par ressource. GraphQL, avec son endpoint unique et ses requêtes POST, ne peut pas exploiter ce mécanisme. Les solutions de cache côté client (Apollo Client, urql) compensent partiellement, mais la mise en cache côté CDN ou proxy reste plus complexe qu'avec REST.

La sécurité des requêtes GraphQL demande une attention particulière. Sans garde-fous, un utilisateur malveillant peut construire une requête profondément imbriquée qui consomme des ressources serveur considérables. Les mécanismes de protection, comme la limitation de profondeur, l'analyse de complexité et les listes blanches de requêtes persistées, sont indispensables en production mais rarement mis en place par défaut.

| Aspect | GraphQL | REST |

|---|---|---|

| Fetching | Précis : le client choisit les champs | Réponse fixe définie par le serveur |

| Nombre de requêtes | Une requête pour des données imbriquées | Plusieurs requêtes séquentielles |

| Cache | Cache applicatif côté client | Cache HTTP natif (CDN, proxy) |

| Courbe d'apprentissage | Élevée (schéma, resolvers, mutations) | Faible (HTTP standard) |

| Monitoring | Plus complexe (endpoint unique) | Simple (un endpoint par ressource) |

| Upload de fichiers | Non natif, nécessite des extensions | Natif via multipart/form-data |

gRPC et tRPC : les alternatives spécialisées

Au-delà du duo REST/GraphQL, deux technologies méritent une attention particulière en 2026 : gRPC pour la communication haute performance entre services, et tRPC pour le typage de bout en bout dans les applications TypeScript.

gRPC : la performance avant tout

Développé par Google et rendu open source en 2016, gRPC utilise HTTP/2 et Protocol Buffers (protobuf) pour offrir des performances largement supérieures à REST et GraphQL. La sérialisation binaire de protobuf produit des payloads jusqu'à dix fois plus compacts que le JSON. Le multiplexage HTTP/2 permet d'envoyer plusieurs requêtes simultanément sur une seule connexion TCP, éliminant la latence du head-of-line blocking.

gRPC excelle dans les architectures microservices internes où la performance est critique. Les communications entre services backend, le streaming de données en temps réel et les systèmes distribués à forte volumétrie sont ses terrains de prédilection. Netflix, Square et Lyft l'utilisent massivement pour leur communication inter-services.

La limitation principale de gRPC concerne l'accès depuis les navigateurs web. Le protocole HTTP/2 avec trailers, nécessaire au fonctionnement de gRPC, n'est pas entièrement supporté par les API web des navigateurs. gRPC-Web contourne cette limitation avec un proxy d'adaptation, mais cette couche supplémentaire annule une partie des gains de performance. Pour les API exposées aux clients web, REST ou GraphQL restent plus adaptés.

tRPC : le typage de bout en bout

tRPC représente une approche radicalement différente. Au lieu de définir un contrat d'interface explicite (OpenAPI, schéma GraphQL, fichier .proto), tRPC exploite le système de types de TypeScript pour inférer automatiquement les types du serveur vers le client. Le résultat est une expérience de développement sans précédent : l'autocomplétion et la vérification de types fonctionnent de bout en bout, sans génération de code, sans schéma à maintenir.

Cette approche a conquis l'écosystème Next.js et les applications full-stack TypeScript. Des frameworks comme Create T3 App ont popularisé la combinaison Next.js + tRPC + Prisma, offrant un typage cohérent de la base de données jusqu'à l'interface utilisateur. La version 11 de tRPC, sortie fin 2025, améliore encore le support du streaming et des Server-Sent Events.

La contrepartie est que tRPC ne fonctionne que dans un écosystème entièrement TypeScript. Si votre backend est en Go, Python ou Java, tRPC n'est pas une option. Et si votre API doit être consommée par des clients non-TypeScript (applications mobiles natives, partenaires externes), vous aurez besoin d'une couche REST ou GraphQL en complément.

| Critère | REST | GraphQL | gRPC | tRPC |

|---|---|---|---|---|

| Format | JSON | JSON | Protobuf (binaire) | JSON |

| Transport | HTTP/1.1 ou 2 | HTTP/1.1 ou 2 | HTTP/2 | HTTP |

| Typage | Via OpenAPI | Schéma natif | Protobuf natif | TypeScript natif |

| Performance | Bonne | Variable | Excellente | Bonne |

| Browser support | Natif | Natif | Via proxy (gRPC-Web) | Natif |

| Cas d'usage | API publiques, CRUD | Interfaces riches, données complexes | Microservices internes | Full-stack TypeScript |

Sécurité des API : authentification, rate limiting et bonnes pratiques

La sécurité des API est un enjeu critique en 2026. Le rapport OWASP API Security Top 10 identifie les vulnérabilités les plus exploitées, et la majorité d'entre elles concernent des problèmes que les développeurs peuvent prévenir avec des pratiques rigoureuses. Une API non sécurisée est une porte ouverte sur l'ensemble de votre système d'information.

Authentification et autorisation

OAuth 2.1, finalisé en 2025, consolide les bonnes pratiques de sécurité qui étaient auparavant dispersées entre plusieurs RFC. La spécification rend obligatoire l'utilisation de PKCE (Proof Key for Code Exchange) pour tous les clients, interdit les flux implicites et impose des durées de vie courtes pour les tokens d'accès. Pour la majorité des cas d'usage, OAuth 2.1 avec des tokens JWT signés constitue le standard de référence.

L'autorisation fine est un aspect souvent négligé. Authentifier un utilisateur ne suffit pas : il faut vérifier qu'il a le droit d'accéder à la ressource spécifique qu'il demande. Le modèle RBAC (Role-Based Access Control) convient aux applications simples. Pour des règles d'accès complexes, ABAC (Attribute-Based Access Control) ou des solutions spécialisées comme Open Policy Agent (OPA) offrent une granularité supérieure.

Protection contre les abus

Le rate limiting est la première ligne de défense contre les abus. Chaque API doit imposer des limites de débit par utilisateur, par IP et par endpoint. Les algorithmes de token bucket et de sliding window sont les plus utilisés. Les en-têtes standardisés RateLimit (draft IETF) permettent de communiquer les limites et le quota restant aux clients, ce qui améliore l'expérience développeur.

Au-delà du rate limiting, les API gateways comme Kong, Tyk et AWS API Gateway centralisent la sécurité en amont des services. Elles gèrent l'authentification, le throttling, la validation des entrées, le logging et la transformation des requêtes. Cette centralisation évite de dupliquer la logique de sécurité dans chaque microservice et facilite le monitoring global du trafic API.

La validation stricte des entrées est une mesure fondamentale mais souvent insuffisante en pratique. Chaque paramètre reçu par l'API doit être validé en type, en longueur et en format. Les bibliothèques comme Zod (TypeScript), Pydantic (Python) ou Joi (JavaScript) permettent de définir des schémas de validation déclaratifs. En complément, les tests de sécurité automatisés dans les pipelines CI/CD détectent les vulnérabilités avant qu'elles n'atteignent la production.

API-first et documentation : concevoir avant de coder

L'approche API-first inverse le processus de développement traditionnel. Au lieu de coder le backend puis de documenter l'API a posteriori, l'équipe commence par définir le contrat d'interface. Le fichier OpenAPI ou le schéma GraphQL devient l'artefact central autour duquel les équipes frontend et backend collaborent en parallèle.

Les bénéfices concrets de l'API-first

Le premier bénéfice est la parallélisation du travail. Une fois le contrat d'API défini et validé, l'équipe frontend peut commencer à développer l'interface en utilisant un serveur mock généré automatiquement à partir de la spécification. L'équipe backend implémente les endpoints réels de son côté. Les deux flux convergent lors de l'intégration, avec un risque d'incompatibilité considérablement réduit.

La génération automatique de code est un autre avantage majeur. À partir d'une spécification OpenAPI, des outils comme openapi-generator et openapi-typescript produisent des SDK clients typés dans le langage de votre choix. Cette génération élimine le code boilerplate, réduit les erreurs de sérialisation et garantit la synchronisation entre le client et le serveur.

La documentation, quand elle est générée à partir de la spécification, est toujours à jour par construction. Les portails développeurs comme Redocly, Stoplight et ReadMe transforment un fichier OpenAPI en une documentation interactive avec des exemples de requêtes, des sandbox de test et des guides d'intégration. Cette documentation vivante remplace les wikis internes qui deviennent obsolètes dès leur rédaction.

Les outils de conception API en 2026

L'écosystème d'outils de conception API s'est considérablement enrichi. Stoplight Studio propose un éditeur visuel pour concevoir des API OpenAPI sans écrire de YAML manuellement. Postman, au-delà de son rôle historique de client HTTP, est devenu une plateforme complète de collaboration API avec des collections partagées, des tests automatisés et des mock servers. Hoppscotch, alternative open source, gagne du terrain auprès des développeurs qui préfèrent un outil léger et auto-hébergeable.

Pour les API GraphQL, Apollo Studio fournit un environnement complet : éditeur de schéma, explorateur de requêtes, monitoring des performances et gestion du graphe fédéré. La fédération GraphQL, qui permet de composer un schéma unique à partir de plusieurs sous-graphes maintenus par des équipes différentes, est devenue la norme pour les organisations à grande échelle.

Tendances émergentes : ce qui change en 2026

Le paysage des API ne cesse d'évoluer. Plusieurs tendances structurelles redéfinissent la manière dont les systèmes communiquent, et certaines d'entre elles pourraient devenir des standards dans les prochaines années.

API et intelligence artificielle

L'essor des modèles de langage a créé une nouvelle catégorie d'API : les API d'inférence. OpenAI, Anthropic, Google et Mistral exposent leurs modèles via des API REST avec des conventions spécifiques : streaming via Server-Sent Events, gestion des tokens, appels de fonctions structurés. Ces API ont popularisé de nouveaux patterns comme le streaming de réponses et les protocoles de communication agent-outil, qui influencent la conception des API au-delà du secteur de l'IA.

Le Model Context Protocol (MCP), proposé par Anthropic en 2025, illustre cette convergence. Il définit un standard de communication entre les agents IA et les outils externes, avec un format de messages structuré qui rappelle les RPC tout en restant compatible avec le web. Cette standardisation facilite l'interopérabilité entre les différents modèles et les services qu'ils consomment.

API asynchrones et event-driven

La spécification AsyncAPI, pendant asynchrone d'OpenAPI, gagne en adoption pour décrire les API événementielles. Les architectures event-driven, où les services communiquent via des messages asynchrones (Kafka, RabbitMQ, NATS), complètent les API synchrones traditionnelles. AsyncAPI 3.0 permet de documenter ces flux événementiels avec la même rigueur que les API REST.

Les webhooks, longtemps considérés comme un ajout secondaire, sont désormais traités comme des citoyens de première classe dans les spécifications API. OpenAPI 3.1 inclut un support natif pour la documentation des webhooks, et des services comme Svix standardisent leur gestion (retries, signature, monitoring) pour les fournisseurs d'API.

Edge computing et API distribuées

Le déploiement d'API au niveau de l'edge, sur les noeuds des CDN, réduit la latence pour les utilisateurs finaux. Cloudflare Workers, Deno Deploy et Vercel Edge Functions permettent d'exécuter de la logique API à quelques millisecondes de l'utilisateur. Cette approche est particulièrement pertinente pour les API de personnalisation, de géolocalisation et de validation de tokens, où chaque milliseconde de latence compte.

La fédération d'API, qu'elle soit implémentée via GraphQL Federation ou via des API gateways distribuées, permet de composer des API cohérentes à partir de services déployés sur différentes régions et différents fournisseurs cloud. Cette distribution géographique améliore la résilience et réduit les points de défaillance uniques.

Le futur des standards

Plusieurs initiatives méritent d'être suivies de près. HTTP/3, basé sur le protocole QUIC, améliore les performances réseau grâce au multiplexage sans head-of-line blocking au niveau transport. Son adoption progresse rapidement, avec plus de 30 % du trafic web mondial en HTTP/3 début 2026. Les API qui exploitent HTTP/3 bénéficient de connexions plus rapides et plus résilientes, notamment sur les réseaux mobiles.

La spécification JSON:API 1.1 propose des conventions standardisées pour les API REST (pagination, filtrage, inclusion de ressources liées), réduisant les décisions arbitraires lors de la conception. TypeSpec, le langage de description d'API développé par Microsoft, ambitionne de remplacer OpenAPI avec une syntaxe plus concise et un système de types plus expressif.

Conclusion

Le choix d'une architecture API en 2026 ne se résume pas à un duel REST contre GraphQL. Chaque technologie, qu'il s'agisse de REST, GraphQL, gRPC ou tRPC, répond à des besoins spécifiques et brille dans des contextes différents. REST reste le choix par défaut pour les API publiques et les cas d'usage CRUD. GraphQL excelle quand les clients ont des besoins de données variés. gRPC domine la communication inter-services haute performance. tRPC offre une expérience développeur sans égale dans l'écosystème TypeScript.

La tendance de fond est claire : les API deviennent plus typées, mieux documentées et plus sécurisées. L'approche API-first, la génération automatique de code et les outils de monitoring spécialisés élèvent le niveau de qualité attendu. Les développeurs qui maîtrisent plusieurs paradigmes d'API et savent choisir le bon outil pour chaque situation disposent d'un avantage concurrentiel réel sur le marché du travail.

Plutôt que de parier sur une seule technologie, investissez dans la compréhension des fondamentaux : le protocole HTTP, les patterns de communication distribués, la sécurité réseau et la conception de contrats d'interface. Ces connaissances fondamentales restent valables indépendamment de la technologie du moment et vous permettront d'adopter sereinement les innovations futures.