Le DevOps a profondément transformé la manière dont les équipes conçoivent, testent et déploient les logiciels. En 2026, les pratiques d'intégration et de déploiement continus ne sont plus réservées aux grandes entreprises technologiques : elles constituent le socle de tout projet sérieux. Ce guide passe en revue les pratiques essentielles, les outils incontournables et les architectures qui font la différence au quotidien.

Sommaire

Le terme DevOps est apparu il y a plus de quinze ans, mais sa signification a considérablement évolué. Ce qui était au départ une philosophie de collaboration entre développeurs et opérationnels est devenu un ensemble structuré de pratiques, d'outils et de méthodologies qui couvrent l'intégralité du cycle de vie logiciel. En 2026, une équipe qui ne pratique pas l'intégration continue ou le déploiement automatisé accumule une dette technique qui finit par freiner l'innovation.

Les chiffres parlent d'eux-mêmes. Selon le rapport State of DevOps 2025, les équipes les plus performantes déploient en production plusieurs fois par jour, avec un taux d'échec des changements inférieur à 5 %. Le délai entre un commit et sa mise en production se mesure en minutes, pas en semaines. Cette vélocité n'est pas le fruit du hasard : elle repose sur des pipelines CI/CD robustes, une conteneurisation maîtrisée et une infrastructure pilotée par le code.

Cet article propose un tour d'horizon complet des pratiques DevOps essentielles en 2026. Des fondamentaux théoriques aux implémentations concrètes, en passant par les outils qui dominent le marché, vous trouverez ici les clés pour structurer ou améliorer votre chaîne de livraison logicielle. Pour approfondir chaque sujet en pratique, consultez ces tutoriels DevOps pour se former.

Les fondamentaux du DevOps en 2026

Le DevOps repose sur un ensemble de principes qui dépassent la simple automatisation. Avant de plonger dans les outils, il est essentiel de comprendre la philosophie sous-jacente qui donne tout son sens aux pratiques techniques.

La culture avant les outils

L'erreur la plus fréquente des organisations qui adoptent le DevOps consiste à acheter des outils sans changer leur culture. Un pipeline Jenkins parfaitement configuré ne sert à rien si les développeurs et les opérationnels travaillent en silos, avec des objectifs contradictoires. Le DevOps exige une responsabilité partagée : l'équipe qui écrit le code est aussi celle qui le déploie et le surveille en production.

Cette approche, souvent résumée par le principe "you build it, you run it", a des conséquences concrètes sur l'organisation des équipes. Les rôles ne disparaissent pas, mais les frontières s'estompent. Un développeur backend doit comprendre les mécanismes de déploiement. Un ingénieur infrastructure doit savoir lire et contribuer au code applicatif. Cette transversalité réduit les temps de réponse aux incidents et améliore la qualité globale du produit.

Les quatre métriques DORA

Le programme DORA (DevOps Research and Assessment) a identifié quatre métriques clés qui permettent de mesurer objectivement la performance d'une équipe DevOps :

- Fréquence de déploiement : à quelle cadence l'équipe livre du code en production. Les équipes élites déploient plusieurs fois par jour.

- Délai de livraison : le temps entre un commit et sa mise en production. Les meilleures équipes atteignent moins d'une heure.

- Taux d'échec des changements : le pourcentage de déploiements qui provoquent un incident. L'objectif est de rester sous les 5 %.

- Temps de restauration : le délai nécessaire pour rétablir le service après un incident. Les équipes performantes restaurent en moins d'une heure.

Ces métriques ne sont pas de simples indicateurs de vanité. Elles sont corrélées à la performance commerciale des organisations. Les entreprises qui excellent sur ces quatre axes livrent plus vite, avec moins de bugs, et génèrent davantage de valeur pour leurs utilisateurs. Comprendre ces fondamentaux est indispensable avant de mettre en place les pratiques que nous allons détailler, et cela s'inscrit dans une démarche plus large de maîtrise du développement web.

Concevoir des pipelines CI/CD performants

Le pipeline CI/CD est la colonne vertébrale de toute démarche DevOps. C'est lui qui transforme un commit en un artefact déployable, en passant par toutes les étapes de validation nécessaires. Un pipeline bien conçu est rapide, fiable et informatif.

L'intégration continue : le premier pilier

L'intégration continue commence par une règle simple : chaque développeur pousse son code au moins une fois par jour sur la branche principale ou sur une branche de courte durée. À chaque push, le pipeline se déclenche automatiquement et exécute une série d'étapes :

- Compilation : le code est compilé ou transpilé pour vérifier qu'il ne contient pas d'erreurs syntaxiques.

- Linting et formatage : les outils comme ESLint, Prettier ou Ruff vérifient que le code respecte les conventions de l'équipe.

- Tests unitaires : la suite de tests unitaires s'exécute pour garantir que les fonctions individuelles se comportent comme prévu.

- Tests d'intégration : les interactions entre les modules sont validées dans un environnement contrôlé.

- Analyse de sécurité : des scanners comme Snyk, Trivy ou Dependabot identifient les vulnérabilités dans les dépendances.

Un bon pipeline CI doit s'exécuter en moins de dix minutes. Au-delà, les développeurs commencent à empiler les commits sans attendre le retour du pipeline, ce qui annule les bénéfices de l'intégration continue. Des techniques comme le parallélisme des étapes, la mise en cache des dépendances et l'exécution incrémentale des tests permettent de maintenir cette rapidité.

Le déploiement continu : du commit à la production

Le déploiement continu prolonge la CI en automatisant la mise en production. Une fois le code validé par le pipeline, il est déployé automatiquement, sans intervention humaine. Cela ne signifie pas absence de contrôle : les déploiements canary, le blue-green deployment et les feature flags offrent des mécanismes de sécurité sophistiqués.

Le déploiement canary consiste à diriger un faible pourcentage du trafic vers la nouvelle version, puis à augmenter progressivement si les métriques restent saines. Le blue-green deployment maintient deux environnements identiques et bascule le trafic de l'un à l'autre en cas de problème. Les feature flags permettent de déployer du code en production sans l'activer immédiatement, ce qui découple le déploiement technique de la mise à disposition fonctionnelle.

Les outils qui dominent en 2026

Le marché des outils CI/CD s'est stabilisé autour de quelques acteurs majeurs. GitHub Actions s'est imposé comme le standard pour les projets open source et les équipes qui utilisent GitHub. Sa marketplace de plus de 20 000 actions prêtes à l'emploi et son intégration native avec l'écosystème GitHub en font un choix pragmatique. GitLab CI/CD reste le concurrent le plus sérieux, avec l'avantage d'une plateforme intégrée qui couvre tout le cycle DevOps : gestion du code, CI/CD, registre de conteneurs, suivi des issues et déploiement.

Dagger mérite une attention particulière. Cet outil permet de définir les pipelines CI/CD en code (Go, Python ou TypeScript), ce qui les rend portables d'une plateforme à l'autre. Vous écrivez votre pipeline une fois et il s'exécute de manière identique sur GitHub Actions, GitLab CI ou en local. Cette portabilité résout un problème récurrent : la dépendance à un fournisseur CI/CD spécifique.

Conteneurs et Docker : le socle de la portabilité

La conteneurisation a résolu un problème vieux comme l'informatique : "ça marche sur ma machine". En encapsulant une application avec toutes ses dépendances dans un conteneur isolé, Docker garantit un comportement identique du poste de développement à la production. Cette portabilité est devenue le fondement des architectures modernes.

Docker en pratique

Un Dockerfile bien écrit suit des principes d'optimisation qui réduisent la taille de l'image et accélèrent les builds. L'utilisation d'images de base minimales comme Alpine Linux ou les images distroless de Google est une première étape. Le multi-stage build permet de séparer l'environnement de compilation de l'image finale, en ne conservant que les artefacts nécessaires à l'exécution.

La gestion des couches Docker est un aspect souvent négligé. Chaque instruction du Dockerfile crée une couche cachée par le moteur Docker. Placer les instructions qui changent rarement (installation des dépendances système) avant celles qui changent souvent (copie du code source) maximise l'utilisation du cache et réduit drastiquement les temps de build. En 2026, des outils comme Docker BuildKit et Buildx offrent des fonctionnalités avancées : builds parallèles, cache distribué et support multi-architecture.

Sécurité des conteneurs

La sécurité des conteneurs est un sujet critique qui a gagné en maturité. Les scanners de vulnérabilités comme Trivy, Grype ou Snyk Container analysent les images Docker à la recherche de failles connues dans les paquets système et les dépendances applicatives. L'intégration de ces scanners dans le pipeline CI/CD permet de bloquer le déploiement d'images vulnérables avant qu'elles n'atteignent la production.

Au-delà du scan d'images, les bonnes pratiques de sécurité incluent l'exécution des conteneurs avec un utilisateur non-root, la limitation des capabilities Linux, l'utilisation de réseaux isolés et la signature des images avec des outils comme Cosign. La supply chain des images de base doit aussi être maîtrisée : utiliser des images officielles, les épingler par leur digest (et non par un tag mutable) et les mettre à jour régulièrement.

Kubernetes et l'orchestration à grande échelle

Quand une application dépasse le stade du conteneur unique, la question de l'orchestration se pose. Kubernetes s'est imposé comme le standard de fait pour gérer des flottes de conteneurs en production. Il automatise le déploiement, la mise à l'échelle, la gestion du réseau et la résilience des applications conteneurisées.

Concepts fondamentaux

Kubernetes fonctionne autour de quelques abstractions clés. Le Pod est l'unité de base : il encapsule un ou plusieurs conteneurs qui partagent le même réseau et le même stockage. Le Deployment gère le cycle de vie des Pods, en garantissant qu'un nombre donné de réplicas est toujours en fonctionnement. Le Service expose les Pods au réseau, avec du load balancing intégré. L'Ingress gère le routage du trafic externe vers les services internes.

Le modèle déclaratif de Kubernetes est sa force principale. Vous décrivez l'état souhaité de votre infrastructure dans des fichiers YAML, et le control plane de Kubernetes travaille en permanence pour atteindre et maintenir cet état. Si un Pod tombe, Kubernetes en relance un automatiquement. Si la charge augmente, un Horizontal Pod Autoscaler ajuste le nombre de réplicas en fonction de la consommation CPU ou mémoire.

Kubernetes managé : la norme en 2026

Gérer un cluster Kubernetes from scratch est un exercice complexe que peu d'équipes peuvent se permettre. En 2026, les services managés dominent largement. Amazon EKS, Google GKE et Azure AKS prennent en charge la gestion du control plane, les mises à jour de sécurité et l'intégration avec les services cloud natifs. Ces solutions réduisent la charge opérationnelle tout en offrant la flexibilité de Kubernetes.

Pour les équipes plus petites ou les projets qui ne nécessitent pas la puissance de Kubernetes, des alternatives comme Fly.io, Railway ou encore les conteneurs managés (AWS Fargate, Google Cloud Run) offrent une expérience plus simple. Ces plateformes abstraient la complexité de l'orchestration tout en conservant les avantages de la conteneurisation. Le choix entre Kubernetes et une solution plus légère dépend de la taille de l'équipe, du nombre de services et des exigences de scalabilité. Cette réflexion s'inscrit dans la stratégie globale d'adoption du cloud computing.

GitOps et infrastructure as code

Le GitOps est une évolution naturelle du DevOps qui place Git au centre de la gestion de l'infrastructure. Le principe est simple : le dépôt Git est la source unique de vérité pour tout ce qui concerne l'état de l'infrastructure et des applications. Toute modification passe par une pull request, ce qui apporte traçabilité, revue de code et historique complet des changements.

Infrastructure as Code avec Terraform et OpenTofu

L'infrastructure as code (IaC) consiste à décrire les ressources d'infrastructure (serveurs, bases de données, réseaux, DNS) dans des fichiers de configuration versionnés. Terraform, créé par HashiCorp, a longtemps été l'outil de référence dans ce domaine. Son langage déclaratif HCL permet de décrire des infrastructures multi-cloud avec une syntaxe lisible et un mécanisme de planification qui montre les changements avant de les appliquer.

En 2025, le passage de Terraform à une licence propriétaire a provoqué la création d'OpenTofu, un fork open source maintenu par la Linux Foundation. En 2026, les deux outils coexistent, mais OpenTofu gagne du terrain auprès des organisations soucieuses de leur indépendance vis-à-vis d'un éditeur unique. Pulumi propose une approche alternative en permettant de définir l'infrastructure dans des langages de programmation classiques (TypeScript, Python, Go), ce qui évite d'apprendre un langage dédié.

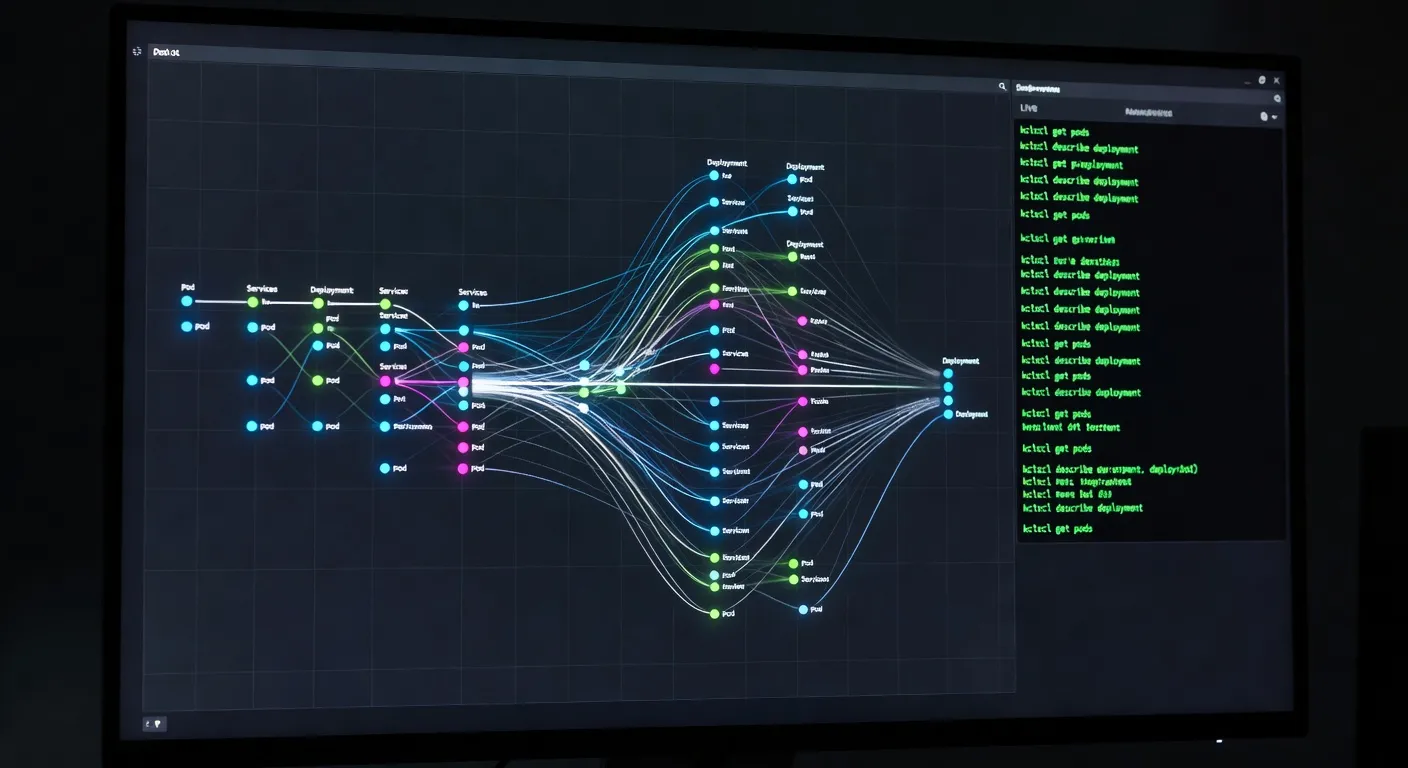

Argo CD et Flux : les piliers du GitOps

Le GitOps sur Kubernetes s'appuie sur des opérateurs qui surveillent un dépôt Git et synchronisent automatiquement l'état du cluster avec la configuration déclarée. Argo CD et Flux sont les deux solutions dominantes en 2026.

Argo CD offre une interface web riche qui visualise l'état de synchronisation de chaque application, les différences entre l'état souhaité et l'état réel du cluster, et l'historique des déploiements. Son modèle d'application permet de gérer des centaines de microservices avec des configurations spécifiques par environnement (staging, production). Flux adopte une approche plus légère et modulaire, avec des composants séparés pour la synchronisation Git, la gestion des images et les notifications.

L'avantage majeur du GitOps est la capacité de rollback instantané. Si un déploiement provoque un incident, il suffit de reverter le commit Git correspondant. L'opérateur détecte le changement et restaure automatiquement la version précédente. Ce mécanisme offre une sécurité incomparable par rapport aux déploiements manuels ou aux scripts de rollback artisanaux.

Gestion des secrets dans un workflow GitOps

Un défi récurrent du GitOps est la gestion des secrets. Les mots de passe, clés API et certificats ne peuvent pas être stockés en clair dans un dépôt Git, même privé. Plusieurs solutions existent pour résoudre ce problème. Sealed Secrets chiffre les secrets avec une clé publique avant de les stocker dans Git : seul le contrôleur Kubernetes possède la clé privée pour les déchiffrer. SOPS (Secret OPerationS) de Mozilla permet de chiffrer sélectivement certains champs dans les fichiers YAML, en s'appuyant sur AWS KMS, GCP KMS ou des clés PGP. External Secrets Operator synchronise les secrets depuis un gestionnaire externe (HashiCorp Vault, AWS Secrets Manager) directement dans les secrets Kubernetes.

Monitoring, observabilité et amélioration continue

Un pipeline CI/CD aussi sophistiqué soit-il ne suffit pas si personne ne surveille ce qui se passe en production. L'observabilité est le troisième pilier du DevOps, aux côtés de l'automatisation et de la collaboration. Elle repose sur trois signaux complémentaires : les métriques, les logs et les traces distribuées.

Les trois piliers de l'observabilité

Les métriques sont des mesures numériques agrégées dans le temps : taux de requêtes par seconde, latence au percentile 99, consommation mémoire, taux d'erreur HTTP 5xx. Prometheus s'est imposé comme le standard open source pour la collecte et le stockage des métriques, avec Grafana pour la visualisation. En 2026, le duo Prometheus-Grafana est complété par Mimir pour le stockage longue durée et Thanos pour les architectures multi-clusters.

Les logs enregistrent les événements discrets qui se produisent dans l'application. Un stack ELK (Elasticsearch, Logstash, Kibana) ou son alternative plus légère Loki-Grafana permet de centraliser, indexer et rechercher les logs de l'ensemble des services. La corrélation entre métriques et logs est essentielle pour diagnostiquer rapidement un incident : une hausse du taux d'erreur dans les métriques guide vers les logs pertinents.

Les traces distribuées suivent le parcours d'une requête à travers les différents services d'une architecture microservices. OpenTelemetry est devenu le standard de fait pour l'instrumentation. Il fournit des SDK pour la plupart des langages et des collecteurs qui exportent les données vers des backends comme Jaeger, Tempo ou des solutions commerciales. La trace permet d'identifier précisément quel service ralentit une requête et pourquoi.

Alerting et incident management

La surveillance sans alerting n'est qu'un tableau de bord décoratif. Un bon système d'alertes respecte plusieurs principes. Les alertes doivent être actionnables : chaque alerte doit correspondre à une situation qui nécessite une intervention humaine. Les seuils doivent être calibrés pour éviter le bruit (trop d'alertes non pertinentes fatiguent les équipes et provoquent l'ignorance des vraies alertes). Les alertes doivent inclure suffisamment de contexte pour permettre un diagnostic rapide : lien vers le dashboard, logs pertinents et runbook associé.

L'incident management moderne s'appuie sur des outils comme PagerDuty, Opsgenie ou Grafana OnCall pour la rotation des astreintes et l'escalade. Les post-mortems sans blâme (blameless postmortems) sont une pratique culturelle essentielle : après chaque incident significatif, l'équipe analyse les causes profondes et identifie les actions préventives, sans chercher de coupable. Ce processus d'amélioration continue est au coeur de la philosophie DevOps.

Vers l'AIOps et l'automatisation intelligente

L'intelligence artificielle commence à jouer un rôle croissant dans les opérations. Les solutions d'AIOps utilisent le machine learning pour détecter des anomalies dans les métriques avant qu'elles ne deviennent des incidents, corréler automatiquement les signaux provenant de sources multiples et suggérer des causes probables. En 2026, ces outils restent complémentaires de l'expertise humaine, mais ils accélèrent considérablement le diagnostic des problèmes complexes dans les architectures distribuées.

L'automatisation de la remédiation est une autre frontière. Les runbooks automatisés, déclenchés par des alertes spécifiques, permettent de résoudre certains incidents courants sans intervention humaine : redémarrage d'un service qui ne répond plus, augmentation temporaire des ressources en cas de pic de charge, basculement automatique vers un service de secours. Cette automatisation libère les équipes des tâches répétitives et réduit le temps de restauration.

Conclusion

Le DevOps en 2026 n'est plus une option : c'est un prérequis pour toute équipe qui veut livrer du logiciel de qualité à un rythme soutenu. Les pratiques essentielles que nous avons passées en revue — culture de la responsabilité partagée, pipelines CI/CD robustes, conteneurisation, orchestration avec Kubernetes, GitOps et observabilité — forment un ensemble cohérent où chaque brique renforce les autres.

L'adoption de ces pratiques ne se fait pas du jour au lendemain. Commencez par les fondations : un pipeline CI qui teste votre code à chaque commit, des conteneurs Docker pour vos applications, un monitoring basique de la production. Puis progressez vers le déploiement continu, le GitOps et l'orchestration à mesure que votre équipe gagne en maturité. Le chemin est progressif, mais chaque étape apporte une valeur tangible en termes de vélocité, de fiabilité et de sérénité pour les équipes.